Aus therapeutischer Sicht sei hier erwähnt, dass eine gesunde Psyche nicht von einer geschützten Intimität zu trennen ist.

Meredith Whittaker ist Anfang September zur neuen Präsidentin der Signal Foundation berufen worden. Netzpolitik.org schreibt über die ehemalige Google-Managerin:

„In den vergangenen Jahren hat Whittaker vor allem gegen Überwachung und Rüstungsdeals gekämpft. Erst bei Google, wo sie seit 2006 13 Jahre lang arbeitete, später an dem von ihr mitgegründeten Forschungsinstitut zu den Auswirkungen künstlicher Intelligenz. Berühmt wurde sie 2018 als Organisatorin der Mitarbeiterinnen-Proteste, die sich daran entzündeten, wie die Google-Führung mit Fällen sexualisierter Gewalt in dem Konzern umging.

Nachdem Whittaker 2019 bei Google „gegangen wurde“, wie sie sagt, lehrte sie als Professorin an der New York University und beriet die US-amerikanische Federal Trade Commission.Whittaker will Signal als Alternative zum Marktführer WhatsApp stärken.

(Anm.: Und in diesem Artikel hier wird sie interviewt: „Die Maßnahmen ebnen den Weg in eine dunkle Zukunft“)

Netzpolitik.org: Sie haben ein eigenes Forschungsinstitut zu künstlicher Intelligenz gegründet und nun sind Sie an die Spitze von Signal berufen worden. In welcher Rolle sind Sie derzeit unterwegs?

Whittaker: Ich trete jetzt allein in meiner Funktion als neue Präsidentin von Signal auf. Darauf werde ich fortan meine Zeit und Energie verwenden. Von meinem Posten als Professorin bin ich zurückgetreten.“

Nun lese ich Euch eine Frage vor, die auch in dem Zusammenhang mit dem, was ich mir heute anschaue, wirklich Relevanz hat.

Netzpolitik.org: Nehmen Sie Unterschiede wahr in der Art, wie in Deutschland und in den USA Überwachung, Privatheit und Datenschutz gesprochen wird?

Whittaker: Deutschland war immer sensibler gegenüber diesen Entwicklungen, aber in den vergangenen fünf Jahren hat es eine Wende in der öffentlichen Debatte in den USA gegeben, die ich sehr begrüße.

Vor den Enthüllungen Edward Snowdens galt man noch schnell als paranoid, wenn man sich über Privatsphäre sorgte. Technologie wurde mit wissenschaftlichem Fortschritt und Innovation gleichgesetzt. Das machte es schwer, das Geschäftsmodell der Überwachung infrage zu stellen, das ein Herzstück der Tech-Industrie ist. Mehr und mehr wächst aber auch bei uns in den USA die Skepsis gegenüber dem angeblichen Nutzen dieser Technologien und die Einsicht, dass es erforderlich sein könnte, diesen Geschäftsmodellen gesellschaftlich und politisch Einhalt zu gebieten.

Frage: Können Sie sagen, was diese Wende herbeigeführt hat?

Whittaker: Es gab eine Reihe von Missgeschicken, die dieses Narrativ von Tech als Fortschritt infrage gestellt haben. Algorithmen-getriebene Plattformen haben die sogenannte Desinformationen verstärkt. Wir haben eine Datenschutzverletzung nach der anderen gesehen und die Unternehmen verfügen über eine Macht, die fast schon der Macht von Regierungen gleicht. Mehr noch, die Konzerne agieren fast wie informelle Regierungen. Aber inzwischen tut sich etwas. Viele Wissenschaftler und Aktivisten haben auf die Entwicklung hingewiesen und dadurch haben wir einen Wendepunkt erreicht, weshalb sich auch der Diskurs verschoben hat.

Frage: Signal wird weltweit immer noch viel seltener genutzt als WhatsApp oder Telegram. Haben Sie Wachstumsziele für bestimmte Länder oder Regionen?

Whittaker: Wir sind immer an Wachstum interessiert gewesen, wegen unserer Mission. Je mehr Menschen Signal nutzen, desto mächtiger wird Signal auch für die, die es nutzen. Unser Ziel ist, jeder sollte mit jeder anderen Person auf der Welt über Signal sprechen können, außerhalb des Überwachungsapparats, in dem wir uns sonst bewegen. Ich kann zum Wachstum keine genauen Zahlen nennen. Wir sehen aber auf jeden Fall Zuwächse bei Nutzerzahlen, wenn in einer bestimmten Region etwas passiert, das die Sensibilität für den Datenschutz weckt. Und wir versuchen natürlich, auf solche Entwicklungen zu reagieren. Wir brauchen Vorkehrungen, mit denen wir uns schützen können, selbst in Zeiten, in denen das nicht erforderlich ist.

Frage: Die EU-Kommission plant die Einführung einer umfassenden Chat-Kontrolle und will auch Messenger wie Signal dazu zwingen, die Verschlüsselung auszuhöhlen. Kriminelle sollen dort nicht mehr abtauchen können, etwa um Darstellungen sexualisierter Gewalt gegen Kinder auszutauschen. Ist Signal ein sicherer Hafen für Kriminelle und Terroristen?

Whittaker: Es gibt Debatten und Wünsche, die alle paar Jahre in ganz ähnlicher Form immer wieder aufploppen. Die aktuelle Diskussion zählt dazu. Dahinter steht das Bedürfnis, Verschlüsselung für einen bestimmten Zweck zu brechen und zugleich für andere Fälle zu erhalten. Aber das funktioniert so nicht, schon rein technisch nicht. Verschlüsselung funktioniert entweder für alle, womit wir unser Versprechen auf Privatsphäre einhalten und einen sicheren Hafen außerhalb des kommerziellen und staatlichen Überwachungskomplexes anbieten können. Oder aber die Verschlüsselung ist für alle kaputt.

Diese Debatten kommen immer wieder an die Oberfläche, aber sie prallen dann auch immer wieder gegen die kalten harten Wände der technologischen Fakten. Es geht schlicht nicht.

Wir bei Signal sind davon überzeugt, dass wir auf private Kommunikation angewiesen sind. Und dafür brauchen wir eine starke Verschlüsselung.

Frage: Einige Politiker argumentieren mit dem Schutz von Kindern. Was entgegnen sie ihnen?

Whittaker: Eine solche Argumentation ist emotional extrem aufgeladen. Niemand kommt umhin, darauf zu reagieren. In den vergangenen Jahren gab es immer wieder heftige Debatten darum, wer die Macht haben sollte, seine oder ihre Privatsphäre zu behalten und wer die Macht haben sollte, sie zu brechen. Ich glaube nicht, dass diese Debatte einfach verschwindet. Wir müssten vielmehr anerkennen, wie emotional aufgeladen diese Themen sind, und das respektieren. Aber noch einmal, so wichtig diese Zielsetzung ist, die technologische Tatsache lässt sich nicht leugnen, dass die Verschlüsselung nicht für einen singulären Zweck gebrochen werden kann und für andere wiederum nicht. Und gleichzeitig gilt, eine Welt ohne Privatsphäre als außerordentlich gefährlich.

Netzpolitik.org: Was das heißt, sehen wir gerade auch nach der Entscheidung des Supreme Courts zum Recht auf Schwangerschaftsabbrüche. Die Entscheidung hat eine Debatte über Privatheit und Verschlüsselung weit über die Vereinigten Staaten hinaus ausgelöst. Plötzlich geht es um die Gefahren von Menstruations-Apps oder verräterische Nachrichten auf Sozialen Medien, die an die Polizei gelangen könnten. Welchen Effekt wird dies auf die Debatten um Technik und Verschlüsselung haben?

Whittaker: Die Gesundheitsversorgung zu kriminalisieren ist eine weitreichende Entscheidung mit außergewöhnlich hohen sozialen Kosten. Für viele hat das auf einer sehr persönlichen Ebene eine Verbindung hergestellt zwischen Fragen der Privatsphäre und der technologischen Privatsphäre, die beide sonst sehr abstrakt und intellektualisiert sind. Wenn der Staat beschließt, die Rechte der Menschen zu untergraben, dann wird Privatsphäre außerordentlich wertvoll. Sie wird existenziell, weil sie sicher stellt, dass Menschen gedeihen und leben und ehrlich miteinander kommunizieren können.

Ich denke, vielen wurde dadurch bewusst, dass sie nicht auf einen gütigen und wohlwollenden Staat hoffen sollten. Wir brauchen Vorkehrungen, mit denen wir uns schützen können… Selbst in Zeiten, in denen das nicht erforderlich ist.

Frage: Sie forschen seit Jahren zu den gesellschaftlichen Auswirkungen von sogenannter Künstlicher Intelligenz. In der Redaktion kursierte vor wenigen Tagen die Werbeanzeige für einen Kaffeevollautomaten, der angeblich mit Hilfe Künstlicher Intelligenz betrieben wird. Die KI sorge dafür, dass die am häufigsten genutzten Programme automatisch auf der Bildschirmanzeige auf den ersten Plätzen landen. Ist KI zu einem Werbeversprechen verkommen?

Whittaker: Die Kaffeemaschine ist ein gutes Beispiel für den wilden Marketing-Hype. Diese Maschine hält ja nur fest, was genutzt wird, und schon ist es künstliche Intelligenz.

KI ist vor allem eine Art Marketingbegriff, der datenzentrierte Produkte für den Verkauf aufwerten soll. Der Stand der KI ist seit nunmehr rund 70 Jahren an dem gleichen Punkt. Der Begriff wurde gleichzeitig in geradezu haarsträubender Weise unterschiedlichen Techniken angedichtet.

An Fahrt gewann das Thema dann vor knapp zehn Jahren, so zwischen 2013 und 2015. Damals gab es kaum eine Ausgabe des Wired Magazines, auf dessen Titelblatt nicht das Thema KI prangte. Und plötzlich wurden all diese Wissenschaftlerinnen und Wissenschaftler gezwungen, die in den hintersten Universitätslaboren werkelten, geradezu zu Rockstars gemacht.

(Anm.: Soviel zum Thema Wissenschaft)

Frage: Was war damals passiert?

Whittaker: Die Unternehmen nahmen maschinelles Lernen, eine Technologie, die eigentlich aus den 80er Jahren stammt, und wendeten sie auf ihre massiven Datenspeicher und gewaltigen Recheninfrastrukturen an. Und sie erkannten, dass sie damit Dinge tun konnten, die zuvor ohne diese Ressourcen nicht möglich gewesen wären.

Im Kern ging es darum, mehr wirtschaftliches Wachstum zu generieren, neue Märkte zu erschließen und die Tech-Industrie zu einem Nervensystem unserer Welt zu machen. KI als Marketingbegriff war extrem erfolgreich dabei.

Netzpolitik.org: Einige Ihrer Kollegen aus der Wissenschafts-Community haben dazu aufgerufen, Begriffe wie künstliche Intelligenz oder maschinelles Lernen nicht länger zu nutzen, weil sie falsche Vorstellungen von den Fähigkeiten dieser Systeme wecken. Stattdessen sollten wir möglichst präzise benennen, was ein System macht, etwa Muster in großen Datenmengen erkennen. Halten Sie das für eine gute Idee?

Whittaker: Das ist eine schwierige Frage. Aus eben diesem Grund habe ich angefangen, den Begriff “künstliche Intelligenz“ in Anführungszeichen zu verwenden. Das ist meine Lösung. Denn es gibt ja bereits einen Diskurs rund um KI. Und es lohnt sich, in diesen Diskurs einzugreifen und klarzustellen: Nein, das ist nicht übermenschlich. Das ist keine Empfindungsfähigkeit. Was das Marketing behauptet, stimmt nicht. Dazu müssen wir diese Begriffe nutzen.

Zum anderen ist es überhaupt schwierig, präzise zu sein. Denn in den allermeisten Fällen, in denen wir mit dieser Technologie in Berührung kommen, ist sie proprietär. Die Unternehmen machen daraus ein Geschäftsgeheimnis. Das ist einer der großen Vorteile, die diese Unternehmen bei ihren Behauptungen haben. Wir können sie nicht überprüfen. Wir haben also nicht die Macht der Präzision, weil wir keine Transparenz haben.

(Anm.: Das kommt mir doch irgendwie bekannt vor mit der fehlenden Transparenz. )

Frage: KI erscheint vielen nicht nur als eine Big Data Black Box, in der man vorne eine Eingabe eingibt und am anderen Ende kommt dann ein Ergebnis heraus. KI-Systemen werden ja mitunter auch orakelgleiche Fähigkeiten, ein Bewusstsein oder gar Weltzerstörungsabsichten unterstellt. Warum geben wir dieser Technologie bereitwillig so viel Macht?

(Anm.: Und jetzt wird es sehr interessant.)

Antwort: Es gibt diese Geschichte über Joseph Weizenbaum, der in den 60er und 70er Jahren als KI-Wissenschaftler arbeitete. Und in seinem Institut gab es einen Chatbot namens Eliza, der in der Lage war, eine Gesprächstherapie zu simulieren. Wie in einer psychologischen Behandlung. „Wie geht es Ihnen?“ „Mir geht es gut?“ „Oh, erzählen Sie mir mehr darüber.“ Eliza verstand natürlich nicht den Inhalt des Gesprächs, aber das System war in der Lage, das Gespräch im Sinne einer therapeutischen Methode weiter zu spinnen.

(Anm.: Allerdings ohne die Spiegelneuronen, die eigentlich dafür zuständig wären…)

Whittaker: Wir reden hier nicht von ChatGBT3 oder von den großen Sprachmodellen, die heute existieren. Eliza war sehr, sehr simpel. Umso verstörender war es mit anzusehen, dass Menschen mit Eliza interagierten, als ob sie ebenfalls ein Mensch wäre.

Es kam vor, dass jemand eines der Labore betrat und ein Angestellter darum bat, nicht gestört zu werden, weil er gerade mit Eliza sprach. Und Teile dieser Unterhaltungen waren in gewisser Weise intim.

Sie statteten Eliza mit menschlichen Qualitäten aus.

Netzpolitik.org: Das bedeutet nicht, dass sie empfindungsfähig war. Richtig?

Whittaker: Richtig. Und doch weisen wir als Menschen zu den Dingen um uns herum eine fast animistische Tendenz auf.

Frage: Woran liegt das?

Whittaker: Die Linguistin Emily Bender hat sehr viel zu KI geforscht, und sie weist darauf hin, dass Menschen dazu neigen, in Gesprächen Pausen zu füllen. Wir hören zu und verleihen der Kommunikation eine Bedeutung und dem Kommunizierenden eine Art Identität in menschlichen Gesprächen.

(Anm.: Nennt man auch Projektion. )

Und eben dies tun wir auch, wenn wir mit einem Bot oder einem System konfrontiert werden. Wir haben es also auch nicht mit einem Bewusstsein zu tun, aber die technologischen Systeme der Unternehmen spielen mit dieser Neigung. Und gerade hier liegt eine Gefahr.

Es ist besonders gefährlich, weil diese Erzählung am Ende extrem positiv für die Unternehmen ist. Wenn du die Kontrolle über ein fühlendes, übermenschliches System hast, dann ist dieses System mächtig, selbst wenn es furchteinflößend ist.

(Anmerkung: Es ersetzt auch Kommunikation mit echten Menschen, wenn diese im Außen verunmöglicht wurde, zum Beispiel durch die Spaltung der Gesellschaft.)

Zwar wissen wir darum, wie kaputt das System ist, wie beschränkt es in vielerlei Hinsicht ist und wie voreingenommen, dass es mit Daten aus Reddit und Twitter geschult wurde und dass diese Daten von unterbezahlten Arbeitern, in einer ehemaligen Kolonie sortiert wurden. Aber wir reagieren dennoch auf eine unangemessene Art.“

(…)

Netzpolitik.org: „Die Europäische Kommission will künstliche Intelligenz stärker regulieren und hat dazu im April vergangenen Jahres einen Verordnungsentwurf veröffentlicht. Und im Februar wurde ein neuer Entwurf zur Verantwortung von KI-Systemen in den US-Kongress eingebracht. Wacht die Politik jetzt auf?

(Anm.: Schmunzel.)

Whittaker: Es ist gut, dass sich die Politik mit dieser Dynamik befasst, sich dabei auch mit der politischen Ökonomie der Branche auseinandersetzt und KI nicht einfach als eine Art natürlich vorkommende Entität in der Welt behandelt.

Aber ich denke, die Politiker gehen nicht weit genug. Sie erkennen nicht, dass KI letztlich ein Produkt des Monopols ist, das durch das Geschäftsmodell der Überwachung entstanden ist.

Nur eine Handvoll Unternehmen verfügen über die entsprechende Computerinfrastruktur. Diese Unternehmen häufen unentwegt riesige Mengen intimer Daten an, mit deren Hilfe sie Vorhersagen über mich treffen können. Solange wir uns nicht mit dieser Tatsache auseinandersetzen, stören wir nicht das Geschäftsmodell und befassen wir uns auch nicht mit KI.

Es handelt sich um komplexe Probleme und es reicht nicht aus, nur einen Teil des Algorithmus einzusehen. Damit gehen wir nicht die grundlegenden strukturellen Missstände an, welche die Wurzel des Problems sind.

Netzpolitik.org: Mit anderen Worten, wenn wir KI regulieren möchten und den Gefahren, die von dieser Technologie ausgehen, begegnen möchten, dann müssen wir regulieren, wer die Daten besitzt und wohin diese fließen.

Whittaker: Ja. Und wer die Infrastruktur besitzt, die den Datenreichtum erst ermöglicht. Ich glaube allerdings nicht, dass es hier nur um den Besitz der Daten geht. Wir geben diesen Unternehmen die Macht, Daten zu schaffen.

Daten sind keine natürlich vorkommende Kraft. Jedes Mal, wenn sich mein Smartphone mit einem Funkturm in der Nähe verbindet, entstehen Daten, die etwas über mich aussagen. Und wenn die Unternehmen diese Daten dann auch noch durch eine Art Vorhersageanalyse jagen, die beliebige Dinge über mich erfinden, dann verfügen diese Informationen – ganz gleich ob sie wahr sind oder nicht – über eine signifikante Macht.

Wir haben diesen Unternehmen somit die Macht der Erkenntnis gegeben.

(Anm.: Den Apfel.)

Und wir müssen uns auch damit auseinandersetzen, wer definiert, wer wir sind und wie das unser Leben beeinflusst. Im Moment tun wir das noch nicht.

Netzpolitik.org: Allerdings kommen einem mitunter auch Zweifel daran, wie mächtig die Tech-Konzerne tatsächlich sind. Kürzlich haben Facebook-Ingenieure zu Protokoll gegeben, dass ihr Unternehmen gar nicht genau weiß, über welche Daten sie genau verfügen und wo diese hinterlegt sind. Kennen die Konzerne möglicherweise gar nicht genau das Ausmaß ihres Datenschatzes und wo dieser vergraben ist?

Whittaker: Das überrascht mich keineswegs. Die Backend-Architektur vieler Unternehmen, die enorme Datenmengen sammeln, ist chaotisch.

Die entscheidende Frage aber lautet: Warum nehmen wir das hin? Das sollte nicht der natürliche Lauf der Dinge sein.

Aber das ist vermutlich das Resultat, nachdem wir Computertechnologie die vergangenen 20, 30 Jahre als natürlich auftretendes Wissenschaftsphänomen behandelt haben und damit auch nicht gestört oder reguliert haben.“

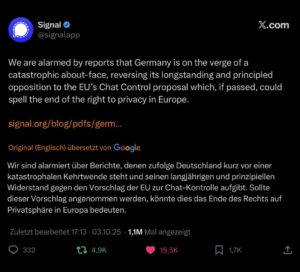

Warum habe ich das vorgelesen? Weil ich hier einen Screenshot mit Euch geteilt habe, der wahrscheinlich auch von Whittaker abgesegnet wurde, bevor man dies hier veröffentlicht hat. Ich zitiere:

“Wir sind alarmiert über Berichte, denen zufolge Deutschland kurz vor einer katastrophalen Kehrtwende steht und seinen langjährigen und prinzipiellen Widerstand gegen den Vorschlag der EU zur Chat-Kontrolle aufgibt.

Sollte dieser Vorschlag angenommen werden, könnte dies das Ende des Rechts auf Privatsphäre in Europa bedeuten.“

Das Menschsein wird, so sehen es zumindest Harari und die anderen selbsternannten WEF-Globalisten, ohnehin überbewertet. Frei nach dem Motto “Wir ziehen durch, was technisch möglich ist, und nennen das zum vierten Male revolutionär.“

Seit Corona gilt der Mensch als überrepräsentiert und grundsätzlich verbesserungswürdig, damit er der Ki-gesteuerten Scheinrealität kontrollierbarer dienlich sein kann.

Wir sollten wieder Briefe schreiben. Um die alle heimlich zu lesen, bräuchte es zumindest mehr als die KI. Es gibt bereits einige Bürger, die sich als Spitzel andienen und eine der vielen Meldestellen anfunken, sobald jemand aus der Reihe tanzt und falsche Gedanken äußert. Gönnt ihnen doch wenigstens einen Lohn dafür. Solange es noch Bäume gibt, die noch nicht für Windräder abgeholzt wurden, gibt es auch Ressourcen für Papier… Wobei… Hanf wächst schneller nach, bräuchte aber Platz, und der wird lieber zubetoniert.

Einige der argwöhnisch-aufmerksamen Mitbürger könnten – wie viele andere auch – demnächst ihre Arbeit verlieren, weil die Wirtschaft nicht verträgt, was hier seit Jahren politisch beschlossen wird. Deutschland finanziert u.a. ein Viertel der weltweiten Klimahilfen, und die Unternehmen, die es sich leisten können, wandern langsam ab oder ersetzen Menschen mit Robotern, weil Klimazertifikate den CO2-Ausstoß zwar nicht minimieren, dafür aber leider die Rendite schröpfen. Die widernatürliche Idee des ewigen Wachstums ist so jedenfalls nicht mehr umsetzbar. So wie Harari es angekündigt hat. Wie beschäftigen wir nur die ganzen „nutzlosen Menschen“, den „bedeutungs- und wertlosen“ Arbeitslosen „ohne Sinn im Leben“ (O-Ton Harari)? Mit “Drogen und Computerspielen“.

Sedierte Weltenbürger mucken nicht auf, und das ist das Ziel. Denn die Technik ist wichtiger als der Mensch. Letzterer sei jetzt nun „hackbar“ und würde künftig wasserdicht abgeriegelt in seinem Denken, Fühlen und Konsumverhalten manipuliert werden können. Ein Hoch auf die vierte industrielle Revolution!

Harari möchte die Zukunft für alle definieren und zwar JETZT

Ich zitiere Harari, den ersten Berater von Klaus Schwab (der das WEF gründete und bis zu seinem Abgang leitete) noch einmal ganz langsam ab Minute 7:30, da der Film ab diesem Zeitpunkt nicht mehr synchronisiert ist:

“COVID ist kritisch, weil dies die Menschen davon überzeugt, die totale biometrische Überwachung zu akzeptieren und zu legitimieren. Wenn wir diese Epidemie stoppen wollen, müssen wir die Menschen nicht nur überwachen. Wir müssen überwachen, was unter der Haut passiert. Was wir bisher gesehen haben, sind Unternehmen und Regierungen, die Daten darüber sammeln, wohin wir gehen, wen wir treffen, welche Filme wir uns ansehen.

Regierungen wollen nicht nur wissen, wohin wir gehen und wen wir treffen. Vor allem wollen sie nun wissen, was unter unserer Haut passiert, wie hoch unsere Körpertemperatur ist… wie hoch unser Blutdruck ist… wie ist unser Gesundheitszustand?

Wer es sich derzeit noch leisten kann, verlässt das Land und wandert in jene Länder ab, die die anderen 99 Komma Schiessmichtot-Prozent der CO2-Verbrechen begehen und sich darüber wundern, dass die Deutschen heroisch die Moralkeule schwingen. Und bist Du der Sucht nach digitaler Bestätigung ins Netz gegangen, sodass es für Dein Ego existenziell wichtig ist, beliebt zu sein, blendest Du das besser aus und greifst jeden persönlich an, der darauf hinweisen möchte. „Wir müssen mit gutem Beispiel vorangehen, und jetzt halt den Mund! Sonst hasse ich Dich!“

Auf und hinein in die automatisiert überwachte Unterhaltung auf Überschriftenniveau! Die Hook muss schon in den ersten zwei Sekunden sitzen, sonst wirst Du weggewischt. Digitale Herzen können nicht so leicht brechen wie die echten. Was die Taktgeber in unseren Torsi angeht, sind wir ja alle mittlerweile abgestumpft genug. Und wenn nicht, verdient die Pharma an uns: Antidepressiva gibt es (noch) auf Rezept. Und auch das ist alles Absicht. Der mitfühlende und selbstwirksame Mensch mit Respekt, gesunden Beziehungen und Offenheit vor der inhaltlichen Vielfalt wird nicht mehr benötigt. Wir reduzieren alles auf das Öffentliche herunter und scheren uns nicht mehr um die Seele. Wer dafür zu sensibel ist, hat ausgedient oder wird halt sediert. Laut dem Bestsellerautor Harari hat es die Seele sowieso nie gegeben – genauso wie den freien Willen. Zitat:

„That’s Over!“

Die schöne neue Welt. Solange dieses und die anderen Bücher von Orwell noch käuflich zu erwerben sind, sollte man sie lesen und vor allem aufbewahren. Sie könnten nämlich bald der digitalen Zensur zum Opfer fallen und in Vergessenheit geraten. In Großbritannien hat man das Buch “1984“ bereits auf die Gefahrenliste gesetzt. Ich erinnere mich vage daran, dass gedankliche Verbrechen aus Druckerschwärze einmal lebensgefährlich waren.

Es bleibt ein ganz mulmiges Gefühl.

Wenn moderne Napoleons ihre wahnhaften Machtphantasien tatsächlich in die Tat umsetzen und einen globalen Überwachungsapparat etablieren, der ein Ausmaß annimmt, das die Selbstbestimmung des Menschen aushebelt, können wir meines Erachtens von der geplanten Abschaffung des ersten humanitären Grundsatzes und somit von einem vorsätzlichen Angriff auf die menschliche Würde sprechen. Dass das all jenen, die Hararis Bücher im Regal stehen haben, nicht auffällt, ist mehr als besorgniserregend.